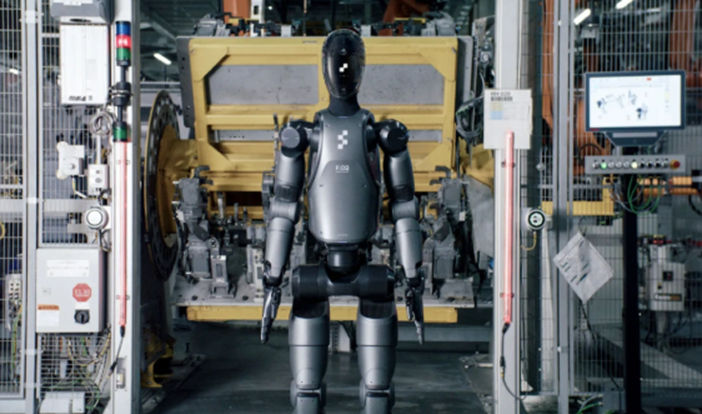

人形机器人制造商Figure AI推出了一种新的视觉-语言-动作AI模型Helix,据该公司介绍,这是第一个通过自然语言直接控制机器人上半身的模型。

Figure表示,与之前的机器人控制系统不同,Helix可以“即时”对物体进行长距离、协作和灵巧地操作,而无需数小时的训练演示或大量的手动编程。

该系统具有很强的对象泛化能力,可以根据自然语言提示挑选训练中未遇到的独特家居用品。

Figure表示,Helix的其他“第一”包括:

多机器人协作。Helix可以同时操作两个机器人,使它们能够解决涉及新物体的共享、长距离操控任务。

整个上身控制。Helix可以对机器人的整个上身进行持续控制,包括头部、躯干、手腕和各个手指。

一个神经网络。Helix使用一组神经网络来学习所有行为,包括拾取和放置物品、使用抽屉和冰箱以及跨机器人交互,而无需任何特定任务的微调。

已做好商业准备。Helix完全在嵌入式低功耗通用处理单元上运行,这使其已做好商业部署的准备。

两套系统控制一切

得益于“系统1、系统2”VLA模型,Helix可以灵活、灵巧地控制其上身的各种动作。

以前,视觉语言模型主干是通用的,但速度不够快,而机器人视觉运动策略的速度很快,但不够通用。Helix可以通过使用经过端到端训练的互补系统相互通信,将两者结合起来。

系统2是一个板载的、经过互联网预训练的VLM,用于场景理解和语言理解,可实现跨对象和上下文的泛化。系统1提供快速、反应灵敏的视觉运动策略,可将系统2的潜在语义表征转化为精确、连续的机器人动作。

系统1的改进

在发布Helix后不久,Figure宣布了对系统1所做的一系列改进,为包裹处理和分类开辟了新的商业用例。

系统1的改进将系统的视觉输入从单眼转换为立体,从而提供更精确、更能感知深度的运动。该系统可以解读精细的细节和更广泛的上下文线索,从而提供更可靠的控制。

这些改进还提供了“学习视觉本体感受”,这意味着每个机器人现在可以自我校准,以实现“无缝”的跨机器人传输。机器人现在还可以在运动模式下运行,这是一种加速技术,可以让它们实现更快的执行速度,同时保持较高的成功率和灵活性。

Figure表示,这些改进对于包裹处理和分类至关重要,这项活动给机器人带来了几个关键挑战。

仓库传送带上的包裹通常具有各种各样的尺寸、形状、重量和硬度,分拣机必须能够适当地处理它们,以便每个包裹都正确定位并且标签朝上以便扫描。

分拣机还必须能够跟上包裹快速、动态地流动,并能够自我纠正,以保持货物流动不间断。

Figure表示,解决这些特定挑战是Figure的主要目标之一,为克服这些挑战所付出的努力已经为Helix的系统1带来了通用改进,可应用于未来的其他用例。